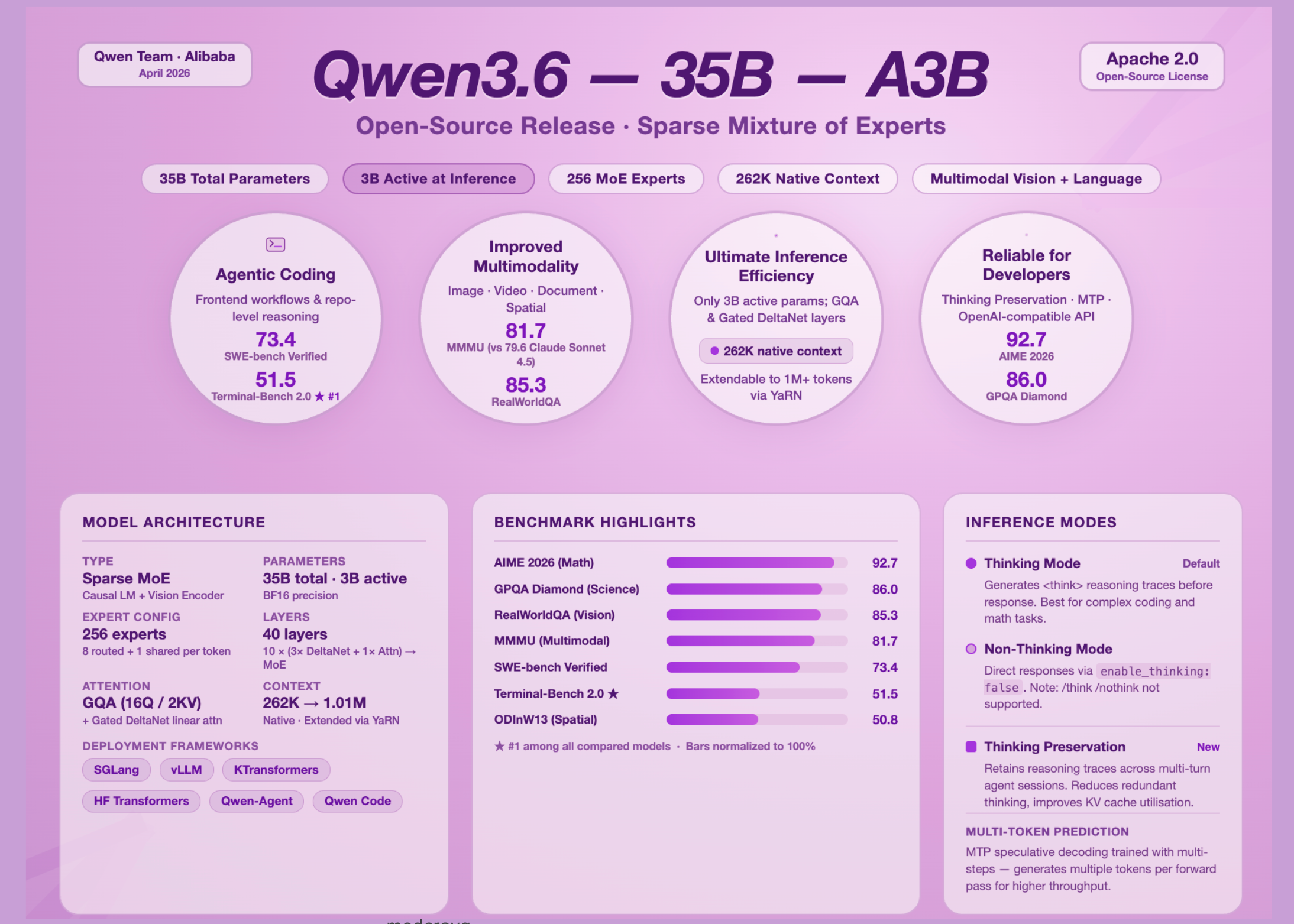

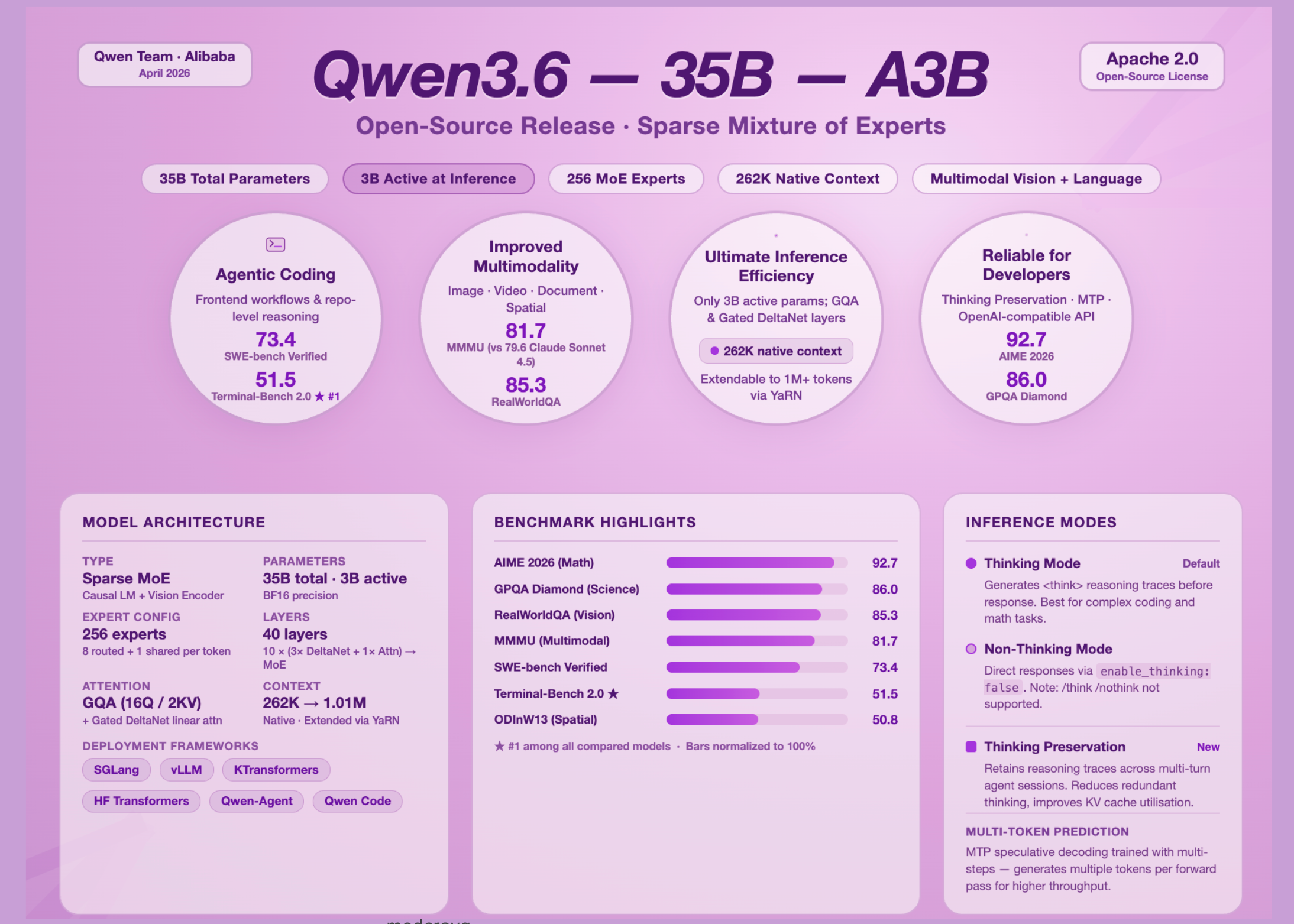

Atvirojo kodo AI kraštovaizdis turi naują įrašą, į kurį verta atkreipti dėmesį. „Qwen“ komanda „Alibaba“ išleido „Qwen3.6-35B-A3B“, pirmąjį atviro svorio modelį iš Qwen3.6 kartos, ir pateikia įtikinamų argumentų, kad parametrų efektyvumas yra svarbesnis už neapdorotą modelio dydį. Iš viso 35 milijardai parametrų, bet tik 3 milijardai suaktyvinti atliekant išvadas, šis modelis užtikrina agentinio kodavimo našumą, konkuruojančią su tankiais modeliais, kurie yra dešimt kartų didesni už aktyvųjį dydį.

Kas yra retas MoE modelis ir kodėl tai čia svarbu?

Ekspertų mišinio (MoE) modelis neveikia visų savo parametrų kiekviename pravažiavime į priekį. Vietoj to, modelis nukreipia kiekvieną įvesties prieigos raktą per nedidelį specializuotų antrinių tinklų, vadinamų „ekspertais“, pogrupį. Likę parametrai neveikia. Tai reiškia, kad galite turėti didžiulį bendrą parametrų skaičių, išlaikant išvadų skaičiavimą, taigi ir išvadų kainą bei delsą, proporcingą tik aktyviam parametrų skaičiui.

Qwen3.6-35B-A3B yra priežastinės kalbos modelis su regėjimo koduotuvu, mokomas tiek prieš treniruotę, tiek po treniruotės, turintis 35 milijardus parametrų ir 3 milijardus aktyvuotų. Jo MoE lygmenyje iš viso yra 256 ekspertai, 8 nukreipti ekspertai ir 1 bendras ekspertas, aktyvuotas kiekvienam prieigos raktui.

Architektūra pristato neįprastą paslėptą išdėstymą, kurį verta suprasti: modelyje naudojamas 10 blokų modelis, kurių kiekvienas susideda iš 3 egzempliorių (Gated DeltaNet → MoE), po kurio seka 1 (Gated Attention → MoE). Iš viso 40 sluoksnių „Gated DeltaNet“ posluoksniai apdoroja linijinį dėmesį – skaičiavimo požiūriu pigesnė alternatyva standartiniam savęs dėmesiui, o „Gated Attention“ posluoksniai naudoja grupuotą užklausos dėmesį (GQA), su 16 dėmesio galvučių Q ir tik 2 KV, o tai žymiai sumažina KV talpyklos atminties spaudimą atliekant išvadas. Modelis palaiko 262 144 žetonų savąjį konteksto ilgį, kurį galima išplėsti iki 1 010 000 žetonų naudojant YaRN (dar vienas RoPE plėtinys) mastelio keitimą.

Agentinis kodavimas yra ta vieta, kur šis modelis tampa rimtas

„SWE-bench Verified“ – kanoninis „GitHub“ problemų sprendimo realaus pasaulio etalonas – Qwen3.6-35B-A3B balas yra 73,4, palyginti su 70,0 už Qwen3.5-35B-A3B ir 52,0 už Gemma4-31B. Terminal-Bench 2.0, kuris įvertina agentą, atliekantį užduotis tikroje terminalo aplinkoje per trijų valandų skirtąjį laiką, Qwen3.6-35B-A3B balas yra 51,5 – aukščiausias iš visų palygintų modelių, įskaitant Qwen3.5-27B (41.6), Gemma4-31B (42.3.5), ir QwenB.5 (42.3.5).

Frontend kodo generavimas rodo ryškiausią patobulinimą. „QwenWebBench“, vidinio dvikalbio priekinio kodo generavimo etalonas, apimantis septynias kategorijas, įskaitant žiniatinklio dizainą, žiniatinklio programas, žaidimus, SVG, duomenų vizualizaciją, animaciją ir 3D, Qwen3.6-35B-A3B pasiekia 1397 balus – gerokai lenkia Qwen3.5-27B)-3B (10n37B)-3. (978).

STEM ir samprotavimo etalonuose skaičiai yra vienodai ryškūs. Qwen3.6-35B-A3B surinko 92,7 balo AIME 2026 (visi AIME I ir II), ir 86,0 balo GPQA Diamond – absolventų lygio mokslinio samprotavimo etaloną – abu konkuruoja su daug didesniais modeliais.

Multimodalinis regėjimas

Qwen3.6-35B-A3B nėra tik teksto modelis. Jis pristatomas su regėjimo koduotuvu ir savaime tvarko vaizdo, dokumentų, vaizdo įrašų ir erdvinio mąstymo užduotis.

Naudojant MMMU (Massive Multi-discipline Multimodal Understanding), etaloną, kuris tikrina universiteto lygmens samprotavimus įvairiuose vaizduose, Qwen3.6-35B-A3B balas yra 81,7, aplenkdamas Claude-Sonnet-4,5 (79,6) ir Gemma4-31B (80,4). RealWorldQA, kuris tikrina vizualinį supratimą realiame fotografijos kontekste, modelis pasiekia 85,3, aplenkdamas Qwen3,5-27B (83,7) ir žymiai daugiau nei Claude-Sonnet-4,5 (70,3) ir Gemma 4-31B (72,3).

Erdvinis intelektas yra dar viena išmatuojamo pelno sritis. ODInW13, objektų aptikimo etalonas, Qwen3.6-35B-A3B balas yra 50,8, palyginti su 42,6 Qwen3.5-35B-A3B. Dėl vaizdo supratimo jis pasiekia 83,7 „VideoMMMU“, pralenkdamas „Claude-Sonnet-4.5“ (77,6) ir „Gemma4-31B“ (81,6).

Mąstymo režimas, nemąstymo režimas ir pagrindiniai elgesio pokyčiai

Vienas iš praktiškai naudingiausių projektavimo sprendimų Qwen3.6 yra aiški modelio samprotavimo kontrolė. Qwen3.6 modeliai pagal numatytuosius nustatymus veikia mąstymo režimu, generuodami samprotavimo turinį <think> žymas prieš pateikdami galutinį atsakymą. Kūrėjai, kuriems reikia greitesnių, tiesioginių atsakymų, gali tai išjungti naudodami API parametrą – nustatymą "enable_thinking": False pokalbio šablone kwargs. Tačiau dirbtinio intelekto specialistai, migruojantys iš Qwen3, turėtų atkreipti dėmesį į svarbų elgesio pokytį: Qwen3.6 oficialiai nepalaiko minkštojo Qwen3 perjungimo, ty /think ir /nothink. Režimo perjungimas turi būti atliekamas naudojant API parametrą, o ne tiesioginius raginimo prieigos raktus.

Naujesnis papildymas yra funkcija, vadinama mąstymo išsaugojimu. Pagal numatytuosius nustatymus išsaugomi tik paskutiniam vartotojo pranešimui sukurti mąstymo blokai; Qwen3.6 buvo papildomai apmokytas išsaugoti ir panaudoti mąstymo pėdsakus iš istorinių pranešimų, kuriuos galima įjungti nustačius preserve_thinking variantas. Ši galimybė yra ypač naudinga agento scenarijuose, kai išlaikant visą samprotavimo kontekstą galima padidinti sprendimų nuoseklumą, sumažinti perteklinį samprotavimą ir pagerinti KV talpyklos panaudojimą tiek mąstymo, tiek nemąstymo režimuose.

Key Takeaways

- Qwen3.6-35B-A3B yra negausus ekspertų mišinio modelis, turintis 35 milijardus iš viso parametrų, bet tik 3 milijardai aktyvuotų išvados metutodėl paleisti žymiai pigiau, nei rodo bendras parametrų skaičius – neprarandant sudėtingų užduočių našumo.

- Modelio agentinio kodavimo galimybės yra stipriausias jo pavyzdyssu 51,5 balo „Terminal-Bench 2.0“ (aukščiausias iš visų palygintų modelių), 73,4 „SWE-bench Verified“ ir dominuojančią 1 397 „QwenWebBench“, apimančią priekinės sistemos kodo generavimą septyniose kategorijose, įskaitant žiniatinklio programas, žaidimus ir duomenų vizualizaciją.

- Qwen3.6-35B-A3B yra daugiarūšis modelispalaikantis vaizdų, vaizdo įrašų ir dokumentų supratimą iš karto, su 81,7 balo MMMU, 85,3 balo „RealWorldQA“ ir 83,7 „VideoMMMU“ – kiekviena iš jų pranoksta Claude-Sonnet-4.5 ir Gemma4-31B.

- Modelis pristato naują mąstymo išsaugojimo funkciją leidžia išsaugoti samprotavimo pėdsakus iš ankstesnių pokalbių posūkių ir pakartotinai panaudoti kelių etapų agento darbo eigose, sumažinant perteklinį samprotavimą ir pagerinant KV talpyklos efektyvumą tiek mąstymo, tiek nemąstymo režimuose.

- Išleistas pagal Apache 2.0, modelis yra visiškai atviras komerciniam naudojimui ir yra suderinamas su pagrindinėmis atvirojo kodo išvadų sistemomis – SGLang, vLLM, KTransformers ir Hugging Face Transformers – su KTransformeriais, specialiai įgalinančiais nevienalytį CPU-GPU diegimą ribotose aplinkose.

Patikrinkite Techninės detalės ir Modelio svoriai. Be to, nedvejodami sekite mus Twitter ir nepamirškite prisijungti prie mūsų 130 000+ ML SubReddit ir Prenumeruoti mūsų naujienlaiškis. Palauk! ar tu telegramoje? dabar galite prisijungti prie mūsų ir per telegramą.

Norite bendradarbiauti su mumis reklamuodami savo „GitHub Repo“ ARBA „Huging Face“ puslapį, išleisdami produktą ARBA internetinį seminarą ir pan.? Susisiekite su mumis